Chcesz dać zespołowi programistów realne wsparcie AI, ale masz z tyłu głowy jedną myśl: „ok, tylko jak nie wypuścić na zewnątrz kodu, sekretów i kontekstu klienta?”. To normalne. W małej firmie jeden nieostrożny prompt może zostać z tobą na długo — nie dlatego, że ktoś działał w złej wierze, tylko dlatego, że nikt nie ustalił zasad gry.

W tym artykule porządkuję temat po ludzku: gdzie najczęściej „uciekają” dane, jak dobrać model wdrożenia, jakie nawyki i procesy działają w praktyce oraz jak ułożyć prostą politykę użycia AI dla zespołu developerskiego.

Co w praktyce oznacza „wyciek danych” przy użyciu AI?

Wyciek danych w kontekście AI najczęściej oznacza, że do narzędzia (czatu, wtyczki, IDE z asystentem) trafia fragment informacji, który nie powinien opuszczać firmy — a potem nie masz już pełnej kontroli, co dalej się z nim dzieje.

Nie chodzi wyłącznie o „tajny kod”. W małych firmach równie wrażliwy bywa kontekst: nazwy klientów w logach, fragmenty umów w ticketach, dane testowe z produkcji, zrzuty konfiguracji chmury, a nawet opisy błędów zawierające ścieżki i nazwy hostów.

Najczęstsze kategorie wrażliwych informacji

- sekrety i dostępy: klucze API, tokeny, hasła, pliki .env, konfiguracje CI/CD;

- kod i architektura: fragmenty repo, logika biznesowa, integracje, wzorce bezpieczeństwa;

- dane klienta: identyfikatory, treści wiadomości, próbki danych, opisy incydentów;

- informacje firmowe: ceny, marże, plany produktowe, backlog, notatki ze spotkań.

Gdzie dane „uciekają” najczęściej? (Zwykle nie tam, gdzie myślisz)

Najwięcej ryzyk pojawia się nie w wielkich decyzjach strategicznych, tylko w drobnych skrótach „na szybko” — bo programista chciał rozwiązać problem w 3 minuty, a nie w 30.

1) Prompty w czacie kopiowane z kodu, logów i ticketów

To najbardziej oczywiste miejsce: wklejenie fragmentu kodu, stack trace’a albo logów z produkcji. Często w logach siedzą nazwy usług, endpointy, identyfikatory, a czasem nawet sekrety (jeśli logowanie jest zbyt gadatliwe).

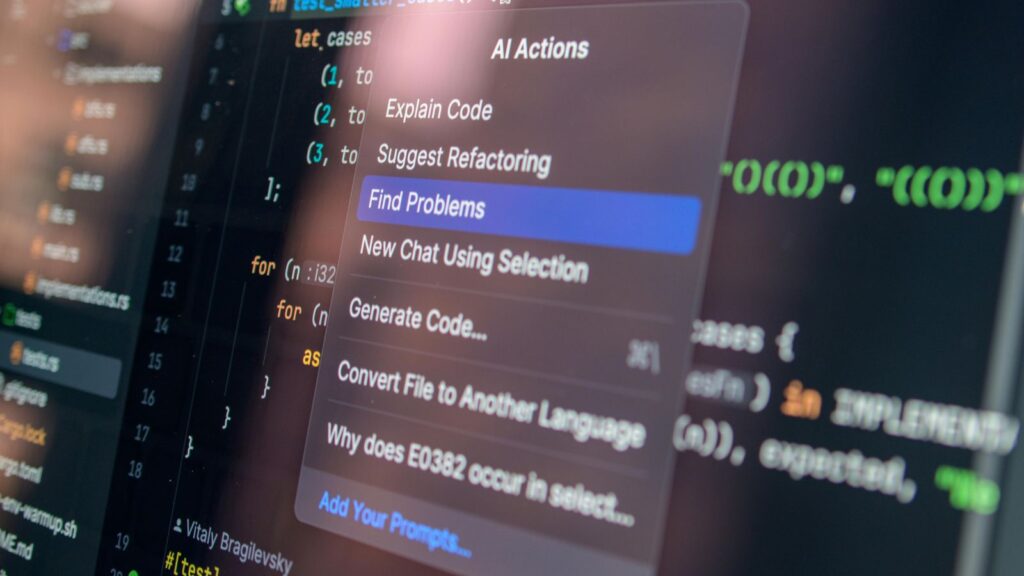

2) Wtyczki i asystenci w IDE z szerokimi uprawnieniami

Wtyczka, która ma dostęp do repozytorium, potrafi „zobaczyć” znacznie więcej niż pojedynczy plik. Jeśli narzędzie działa w trybie chmurowym, a nie masz jasności co do retencji danych, robi się nieprzyjemnie.

3) „Sprytne” automatyzacje: boty na Slacku, integracje z Jirą, helpdeskiem

Automatyczne podsumowania zgłoszeń czy generowanie odpowiedzi do klienta bywa świetne… dopóki do modelu nie trafiają pełne treści rozmów, dane kontaktowe i szczegóły środowiska produkcyjnego.

4) Dane testowe zbyt podobne do produkcyjnych

W wielu firmach testuje się na danych „prawie produkcyjnych”, bo tak jest szybciej. AI wciąga takie próbki bez refleksji — a potem trudno udowodnić, że nie naruszyło to wewnętrznych zasad lub umów z klientem.

Jak wybrać model wdrożenia AI, żeby ograniczyć ryzyko?

Najprościej: im bliżej twojej infrastruktury i im mniej „pamięci” po stronie dostawcy, tym mniejszy obszar ryzyka. Ale rośnie koszt, złożoność i odpowiedzialność po twojej stronie. To klasyczny kompromis.

Opcja A: narzędzia chmurowe (SaaS) z ustawieniami prywatności

To najszybszy start. W praktyce warto szukać rozwiązań, które jasno opisują: czy dane są używane do trenowania, jak działa retencja, jak wygląda izolacja tenantów, jakie są certyfikaty i gdzie są przetwarzane dane.

Plus: szybkość wdrożenia i wygoda dla zespołu. Minus: zaufanie do dostawcy i trudniejsza kontrola „co dokładnie wypłynęło”.

Opcja B: „enterprise” / prywatne instancje u dostawcy

To podejście, które często wybierają firmy, gdy zespół chce korzystać z AI na co dzień, ale potrzebuje wyraźniejszych gwarancji w umowie i konfiguracji (np. krótszej retencji, wyłączenia trenowania, osobnych kluczy, logowania i kontroli dostępu).

Opcja C: self-hosting / uruchomienie modelu w swojej infrastrukturze

Tu zyskujesz największą kontrolę nad danymi, ale też przejmujesz ciężar: aktualizacje, bezpieczeństwo, monitoring, koszty infrastruktury oraz jakość działania. W małych firmach to ma sens zwykle wtedy, gdy naprawdę istnieje twardy wymóg „nic nie wychodzi”, a zespół ma zasoby, by to utrzymać.

Praktyczna zasada: osobne narzędzia do osobnych klas danych

Wiele firm stabilizuje temat, dzieląc użycie AI na dwa tory: „publiczne” (bez wrażliwych danych) i „wewnętrzne” (z dostępem do repo, ale pod silną kontrolą). To mniej efektowne niż „jedno AI do wszystkiego”, ale dużo bardziej przewidywalne.

Polityka promptów, która działa w małej firmie (bez korporacyjnego tonu)

Dobra polityka użycia AI ma jedną cechę: ludzie są w stanie ją stosować w codziennej pracy. Jeśli jest zbyt długa albo zbyt formalna, przegrywa z presją czasu.

Oto podejście, które zwykle się sprawdza w zespołach 2–30 osób.

1) Reguła „zero sekretów”

Najprostsze zdanie, które ratuje najwięcej: do AI nie trafiają tokeny, klucze, hasła, pliki .env ani fragmenty konfiguracji z dostępami. Nawet jeśli „to tylko na chwilę”.

2) Minimalny kontekst zamiast pełnego wklejania

W wielu przypadkach wystarczy opisać problem i wkleić mały, sztuczny przykład (zmyślone nazwy, dane, uproszczony kod). AI i tak poradzi sobie z sugestią rozwiązania, a ryzyko spada radykalnie.

3) Anonimizacja jako nawyk, nie jako projekt

Jeśli zespół ma pracować na realnym logu lub fragmencie danych, warto przyjąć prosty rytuał: zamiana nazw klientów, domen, identyfikatorów i ścieżek na neutralne. Najlepiej, gdy w repo istnieje gotowy „szablon anonimizacji” albo krótka instrukcja, jak to robić konsekwentnie.

4) Zasada „AI proponuje, człowiek odpowiada”

Wykorzystuj AI do przyspieszania: szkiców, testów, refaktorów, dokumentacji. Ale odpowiedzialność za wynik (i jego bezpieczeństwo) zostaje po stronie zespołu. To pomaga też w rozmowie z klientem: AI jest narzędziem, nie wykonawcą.

Techniczne zabezpieczenia: co realnie zmniejsza ryzyko wycieku?

Same „zasady” nie wystarczą, gdy w firmie jest tempo. Najlepszy efekt daje połączenie nawyków z techniką: tak, żeby błędy były trudniejsze do popełnienia.

DLP i blokady na sekrety

Jeśli używacie narzędzi do wykrywania sekretów w repozytorium lub w CI, warto rozszerzyć myślenie: sekrety mogą wypłynąć nie tylko do repo, ale też do promptów. W części organizacji stosuje się firmowe proxy lub bramki, które potrafią wykrywać wzorce tokenów i ostrzegać (albo blokować) wysyłkę.

Separacja kont i dostępów

W praktyce pomaga rozdzielenie: kto ma dostęp do asystenta z kontekstem repo, kto może korzystać z narzędzi w chmurze, a kto tylko z „bezpiecznego” trybu bez historii. Do tego dochodzi zwykła higiena: SSO, role, audyt logów.

Repozytorium „do rozmów” zamiast rozmów o produkcji

Sprytny wzorzec z małych firm: utrzymuj małe repo / zestaw przykładów, które są w 100% bezpieczne do wklejania w prompt (syntetyczne dane, przykładowe moduły, typowe błędy). Zespół szybciej korzysta z AI, bo ma „materiał treningowy”, a nie sięga po produkcję.

Kontrolowany RAG (własna baza wiedzy) zamiast wklejania wszystkiego

Jeśli potrzebujecie, by AI „znało” dokumentację i standardy, często lepiej zbudować wewnętrzną bazę wiedzy i podawać modelowi tylko to, co potrzebne w danym momencie, zamiast wklejać długie fragmenty wiki czy umów. To nie jest wyłącznie technologia — to sposób ograniczania ekspozycji danych.

Jak to poukładać procesowo w zespole programistów? (Bez hamowania pracy)

Największy błąd małych firm to „albo wszystko wolno, albo wszystko zakazane”. Pierwsze kończy się chaosem, drugie obchodzeniem zakazu. Środek to prosty proces, który chroni firmę i nie wkurza zespołu.

1) Szybka klasyfikacja informacji

Wystarczą trzy poziomy, które każdy rozumie: informacje publiczne, wewnętrzne i wrażliwe. Kluczowe jest jedno: co można wkleić do narzędzia chmurowego, a co może trafić wyłącznie do rozwiązań pod kontrolą firmy (lub wcale).

2) „Bezpieczne przykłady” jako element code review

Warto, żeby w review pojawiło się pytanie kontrolne: czy w opisie zadania, komentarzach, commitach lub wklejkach do narzędzi nie znalazły się dane klienta albo sekrety. Nie chodzi o polowanie na błędy, tylko o budowanie nowej normy.

3) Krótka lista dozwolonych przypadków użycia

W większości zespołów bardzo dobrze działają scenariusze „zielone”, czyli takie, które dają korzyść bez dotykania wrażliwych danych. Na przykład: generowanie testów jednostkowych na podstawie interfejsu (bez implementacji), propozycje refaktoru dla syntetycznego przykładu, streszczanie publicznych RFC, poprawa czytelności komunikatów błędów bez danych klienta.

4) Jeden właściciel tematu (nawet jeśli to mała rola)

W małej firmie musi istnieć osoba, która zbiera pytania, aktualizuje zasady i pilnuje spójności konfiguracji. To nie musi być etat. Ważne, żeby temat nie był „niczyj”.

Przykładowy „bezpieczny” workflow: jak korzystać z AI i nie wklejać produkcji

Oto prosty schemat, który często działa w praktyce, zwłaszcza gdy zespół jest pod presją dowożenia.

- Opisujesz problem własnymi słowami (co nie działa, jaki jest oczekiwany efekt), bez nazw klientów i bez danych środowiska.

- Tworzysz minimalny przykład kodu lub danych, który odtwarza błąd. Jeśli to możliwe, używasz sztucznych nazw i wartości.

- Prosisz AI o propozycje (hipotezy, testy, warianty refaktoru), ale traktujesz to jako listę pomysłów, nie jako prawdę objawioną.

- Weryfikujesz lokalnie w swoim środowisku, a wynik przechodzi normalną ścieżkę: testy, review, CI.

- Dokumentujesz wnioski w wewnętrznej bazie wiedzy, żeby następnym razem nie trzeba było wklejać coraz większego kontekstu.

Najczęstsze pułapki przy wdrożeniu AI w dev teamie

Jeśli miałbym wskazać trzy momenty, w których firmy najczęściej tracą kontrolę, to byłyby to poniższe sytuacje.

- „Tylko raz wkleję cały plik” — i nagle „raz” staje się nawykiem.

- Brak jasnej odpowiedzi, które narzędzie jest firmowe — ludzie używają prywatnych kont i prywatnych wtyczek, bo tak jest szybciej.

- Entuzjazm bez procesu — AI daje szybki efekt, więc zespół idzie szeroko, zanim ustalicie granice.

Da się temu zapobiec bez dramatów: przez minimalne zasady, sensowne narzędzia i regularne przypominanie „dlaczego to robimy”.

FAQ: AI w firmie developerskiej bez wycieku danych

Czy samo wyłączenie „trenowania na danych” rozwiązuje problem?

Nie w pełni, bo pozostają kwestie retencji, logów, uprawnień wtyczek i tego, co faktycznie trafia do promptów.

Czy można korzystać z AI, jeśli pracujemy na kodzie klienta?

Najczęściej tak, ale wymaga to jasnych zasad i świadomości, jakie informacje są wrażliwe oraz jakie narzędzia mają dopuszczony poziom przetwarzania danych.

Co jest bezpieczniejsze: czat w przeglądarce czy asystent w IDE?

Zwykle większe ryzyko niesie asystent w IDE, bo może mieć szerszy dostęp do repozytorium i kontekstu, jeśli nie jest dobrze skonfigurowany.

Jak przekonać zespół, żeby nie wklejał logów z produkcji?

Najlepiej działa połączenie prostych zasad z gotowymi, „bezpiecznymi” przykładami oraz narzędziami, które utrudniają przypadkowe wysłanie sekretów.

Czy self-hosting AI zawsze jest najlepszym wyjściem?

Nie zawsze, bo zwiększa koszty i odpowiedzialność po stronie firmy; często lepszy efekt daje rozsądny podział narzędzi i kontrola tego, co trafia do modeli.